Warum sind sogenannte „KI“ zu dumm für einfachste Rechenaufgaben?

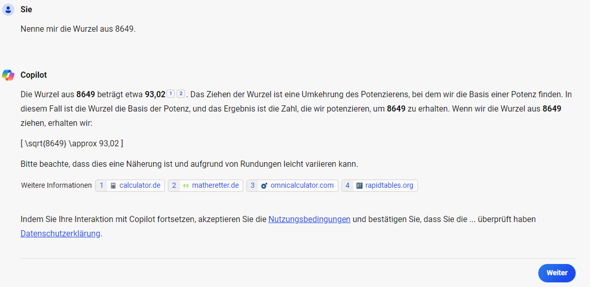

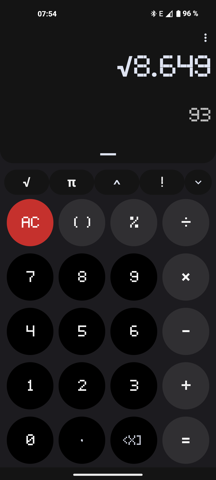

Beispiel: Ich wollte die Wurzel aus 8649 wissen. Das Ergebnis ist ganz eindeutig 93, denn 93*93 oder 93^2 ergibt nunmal 8649. Diese Pseudo-KI von Google/Bing/ChatGPT 4 kam aber zu folgendem Schluss:

9 Antworten

Das ChatGPT nicht rechnen kann sollte sich inzwischen herum gesprochen haben.

Weil es keine KI gibt. Was du meinst, ist ML. ML kann nicht denken, sondern gibt nur das wieder, was es gelernt hat. ML steht für Machine Learning. KI ist ein Oberbegriff, den wir zurzeit noch nicht erreicht haben. In ChatGPT 4 haben die deshalb den Analyse Modus eingebaut, welcher es ChatGPT erlaubt, solche Berechnungen per Python Script vorzunehmen. Wenn du mal ein Ergebnis bekommst, welches richtig sein sollte, ohne den Analysemodus, dann liegt es daran, dass es genau so in den Trainingsdaten vorhanden war

Weil es keine KI gibt. Was du meinst, ist ML.

Du widersprichst Dir selbst.

Machine Learning ist ein Teilbereich der Künstlichen Intelligenz.

KI ist ein Oberbegriff, den wir zurzeit noch nicht erreicht haben.

Das ist schlicht falsch.

KI ist ein Teilbereich der Informatik und umfasst jene Bereiche, die das Imitieren von menschlichem verhalten wie logischem Denken, Lernen, Planen oder der natürlichen Sprache befassen.

Du verwechselst KI offenbar mit Künstlicher Allgemeiner Intelligenz -> jene "Programme mit Bewusstsein", die man aus Sci-Fi Filmen kennt.

AGI ist bisher nur Teil der Theoretischen Informatik.

Ich denke die KI hat hier, statt das richtige Ergebnis zu ergooglen, eine programmiertechnische Rechenoperation ausgeführt, und dabei einen Rundungsfehler entstehen lassen. Die sqrt() Funktion funktioniert mittels Graphanalyse und Mittelpunktsberechnung, kann sein dass da irgendwo ein unsauberes Ergebnis entstanden ist was dann zu einem vollgefehler geführt hat. Sei doch so gut und berichtige die KI, dann merkt sie es sich für den nächsten.

ChatGPT 4 triggert ein Python Script, welches rechnet und an ChatGPT die Antwort gibt. Demnach ist es schwierig. Er rechnet nicht selbst wie ein Mensch, sondern gibt die Aufgabe ab, aber wenn man die Rechnung triggert, kann man das auch als eine Art rechnen bezeichnen, denke ich. Hier kommt es also stark auf die Definition an

Genau das meine ich doch mit "programmiertechnischer Rechenfunktion".

Sei doch so gut und berichtige die KI, dann merkt sie es sich für den nächsten.

Das funktioniert nicht :) Das weißt du aber auch. Diese Programme sind nicht durch Benutzer veränderbar.

Bis zu einem gewissen Grad schon. Diese Systemen leben vom lernen durch den Menschen. Füttert man dem System Infos, wird am anderen Ende geschaut ob die Infos stimmen, und wenn ja, dem System näher gebracht. Das ist das Prinzip von maschinellem lernen.

Das Ergebnis der KI ist abe richtig...

Die Angabe von zwei Dezimalen impliziert 93,015≤√8649<93,025, was offensichtlich falsch ist.

Die Antwort 93,02±0,02 wäre dagegen in Ordnung.

Bitte lies Dir mein Kommentar nochmal durch, diesmal aber ordentlich.

Achte bitte auf das fettgeschriebene Wörtchen annähernd. ;)

Lies Dir auch den Screenshot des FS nochmal durch. Achte auf das Wörtchen "etwa". ;)

Das ist ein typischer DAU Fehler -> Der User benutzt das falsche Tool und beschwert sich über das Ergebnis.

Du hast Chatbots benutzt. Deren Aufgabe ist es mit Dir zu chatten, nicht zu Rechnen...

Zudem verweist Dich der Chatbot in Deinem Screenshot sogar auf Taschenrechner und gibt Dir die Information, dass das eigene Ergebnis lediglich eine Annäherung ist.

Nein. ChatGPT "rechnet" überhaupt nicht.

Weitz / HAW Hamburg über „ChatGPT und die Mathematik“