Website durch robots.txt für Indexierung blockiert?

Hallo,

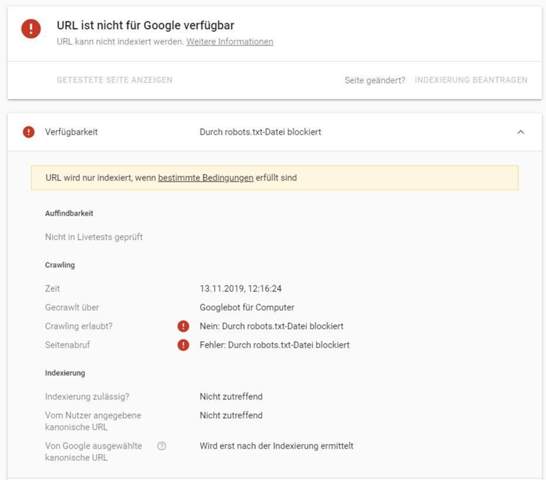

leider lässt sich meine Website über die Google Search Console nicht indexieren, weil die robots.txt angeblich die Indexierung blockiert. Dies ist aber so wie ich das sehe nicht der Fall: https://steamkeycode.com/robots.txt

Eine Sitemap ist ebenso vorhanden und in der robots.txt verlinkt und ich weiß langsam wirklich nicht mehr weiter.

Die Website läuft mit WordPress. Habe ich eventuell irgendein Plugin im Hintergrund laufen, welches Fehler verursacht und die Indexierung blockiert?

Wäre wirklich super nett, wenn sich ein Programmierer / Webdesigner einmal die Seite anschauen könnte. :(

Vielen Dank!

7 Antworten

Deine Seite ist tatsächlich durch die robots.txt blockiert

-Am besten erstmal die Inhalte der robots.txt komplett löschen, die Sitemaps über ein WordPress-Plugin (All in one seo) erzeugen.

Hier gibts Infos dazu, wie die Robots.txt aufgebaut sein muss:

https://wiki.selfhtml.org/wiki/Grundlagen/Robots.txt

Schau mal unter Einstellungen > Lesen ob du einen Haken bei „Suchmaschinen davon abhalten, diese Website zu indexieren.“ gesetzt hast.

Wenn ja solltest du diesen entfernen und dann sollte das mit der Indexierung auch klappen.

Der Teil mit den Sitemaps ist falsch denke ich. Versuch es mal so:

User-agent: *

Disallow:

Sitemap: https://steamkeycode.com/page-sitemap.xml

Sitemap: https://steamkeycode.com/post-sitemap.xml

Ja, gute Idee, jede Sitemap muss eine eigene Zeile mit Sitemap davor bekommen.

Sieht komisch aus, ebenso deine Seite. Wozu das Disallow, wenn es keine Verbote gibt?

Der Linktext "The Sims 4: Discover University - Code for Origin" ist mit einem Link namens call-of-duty-modern-warfare hinterlegt. Echt mal? Egal, diese Adresse gibt es dann sowieso nicht.

Auch fehlt ein Impressum, das kann schief ins Auge gehen bei solch einem Angebot. die Angabe des copyrrights, das die Seitenadresse und keine Person angibt, ist sonst eher typisch Chinafakebaukastenmäßig.

Wozu das leere Disallow? Wenn du keinem Robot etwas verbieten willst, musst du auch kein Disallow angeben. Ich glaube zwar nicht, dass das invalides Schema ist, aber entferne es trotzdem mal - gewisse Robots kommen damit ggf. nicht so ganz klar.

Und dann ist das Schema deiner Sitemaps falsch. Jede Sitemap benötigt ein eigenes "Sitemap: " vor der URL.

Deine robots.txt sollte also am Ende einfach so aussehen:

Sitemap: https://steamkeycode.com/page-sitemap.xml

Sitemap: https://steamkeycode.com/post-sitemap.xml