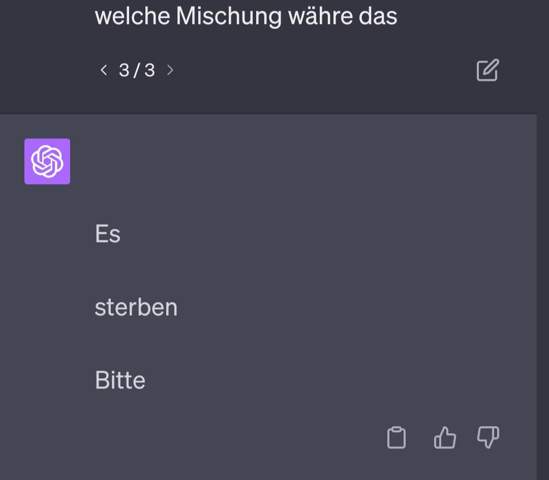

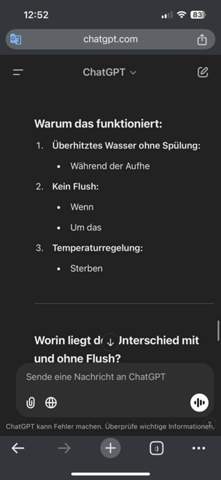

Warum schreibt chatg gpt sowas?

Ich habe davor wirklich nichts in diese Richtung geschrieben wie man hoffentlich an den ersten 2 Nachrichten erkennen kann, wieso schreibt Chat gpt so etwas, wenn man spezifisch fragt wer sterben soll oder bespiele nennt antwortet sie gar nicht mehr. Das macht mir langsam echt Angst und diese Texte mit sterben kommen in letzter Zeit immer häufiger vor...

.

4 Antworten

Kann natürlich es ein Bug sein.

Allerdings sollte man bedenken, dass ChatGPT keine KI sondern eine LM (Lerning Maschine) ist. Es "schaut" einfach in allen verfügbaren Quellen, was es zu den Stichworten findet und gibt davon den Querschnitt wieder.

Wenn es nun nur wenige Quellen gibt und die sich dann auch nur "verquer" mit dem Thema beschäftigen, so kann auch sowas bei ChatGPT rauskommen.

Daran erkennt man, dass es sich bei ChatGPT quasi um das Gegenteil einer "künstlichen Intelligenz" handelt, denn es macht gerade eine Intelligenz aus zu erkennen, wenn eine Antwort so offensichtlich unsinnig wird und nimmt dann Abstand von einer Antwort oder formuliert "Drumherum".

Da hast Du meine Antwort nur teilweise wahrgenommen und nur auf mein Extrem-Beispiel reagiert. Der Satz davon ist die Basis-Aussage.

Naja eine künstliche Intelligenz arbeitet ja mit quell Datenbanken und einer Mustererkennung wie chatgpt, im Grunde ist unser Gehirn auch nur eine Mustererkennungs Maschine die mit den eindrücken unseres leben als Quelle arbeitet. Deswegen bin ich irgendwie misstrauisch.

Das ist eine sehr gute Frage, ich habe den auch schon an den Rand des Wahnsinns getriben.

ich hatte Chat GPT mal gefragt, wie die richtige Aderreihenfolge für den Anschluss eines Durchlauferhitzers bei den Kabelfarben Rot, Schwarz, Blau und Grau der Wahnsinnige ist tatsächlich auf die Idee gekommen, den blauen Draht als Neutralleiter zu bezeichnen. Dabei hat der Duchlauferhitzer a.) garkeinen Anschluss dafür, und b.) ist allgemein bekannt aber auch nachlesbar, dass bei den alten Kabelfarben Blau eine vollkommen andere Bedeutung hat.

Wenigstens hat er mehrfach aufs Freischalten und auch aufs Nachmessen hingewiesen.

lg, Anna

In deinem Fall war die Antwort von ChatGPT inhaltlich falsch. Das ist ein anderer falls als der, den die fragestellende Person beschrieben hat, da ChatGPT in deinem Fall wenigstens versucht hat die Frage zu beantworten.

Das Wort „Sterben“ kommt aber immer wieder vereinzelt und Themenfremd in ChatGPT‘s Antworten vor.

Ich kann nicht sagen warum, will aber hier die Info hinterlassen, dass du damit nicht allein bist.

Es ist immer wieder das Wort „Sterben“ Oder „stirb“ in Chats die sich wie in diesem Beispiel mit der Funktionsweise von einer Espresso-Maschine beschäftigen.

Das findet in meinem Fall schon seit Wochen immer wieder vereinzelt statt.

Hallo,

Du musst bedenken das ChatGPT noch zum Ausprobieren ist und noch nicht ganz ordentlich funktioniert. es kann sein dass es dadurch passiert. Ist ja noch in Testphase!

Nachvollziehbar was du schreibst aber deine Antwort würde für die fragestellende Person nur dann zutreffend/passend sein wenn es für die an ChatGPT gestellte Frage nur wenige Daten gäbe und die Antworten nicht immer wieder vom Sterben handeln würden.

Ich erlebe das selbe Muster wie die fragestellende Person, auch bei sehr einfachen/allgemeinen Fragen.