Ist das Konzept der technologischen Singularität plausibel?

Der US-amerikanische Erfinder, Transhumanist und Futurologe Ray Kurzweil prognostiziert, dass um 2045 die technologische Singularität eintreten wird. Damit ist der Zeitpunkt gemeint, zu dem künstliche Intelligenz die menschliche Intelligenz übertrifft, die Menschheit ihre biologischen Grenzen sprengt und womöglich sogar Unsterblichkeit erreicht. Es gibt auch etliche Bücher und Dokumentationen dazu.

Findet ihr das Konzept an sich plausibel? Wenn ja, wie weit sind wir noch davon entfernt? Ist 2045 grundsätzlich ein realistisches Datum? Freue mich auf verschiedene Sichtweisen.

9 Antworten

Die überwiegende Mehrheit seiner Vorhersagen sind bisher ziemlich akkurat eingetreten.

Kurzweil ist einer der wenigen Menschen, die verstanden haben, dass technologischer Fortschritt aufeinander aufbaut.

Neue Erkenntnisse in der Mathematik beeinflussen den Fortschritt in der Physik, der wiederum einen Effekt auf die Chemie hat, der dann zu Änderungen in der Biologie führt usw. Wir konnten die Hard- und Software von 2015 nicht mit den technischen Möglichkeiten von 2010 entwickeln. Mit der Technik von 2010 haben wir erst die Technik von 2011 möglich gemacht, mit der wir wiederum die Produkte von 2012 herstellen konnten usw. All das erscheint enorm trivial, und doch scheinen das viele zu übersehen.

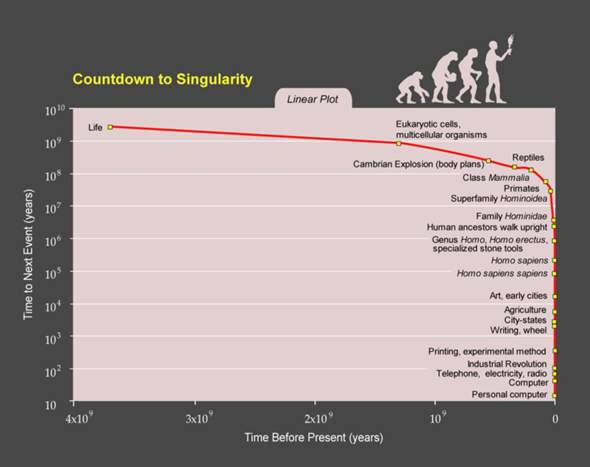

Viele seiner Vorhersagen basieren auch schlicht auf seiner in einem 2001 auf seiner Website publizierten Artikel erstmals formulierten Law of Accelerating Returns, wonach die Veränderungsrate in einer Vielzahl von evolutionären Systemen tendenziell exponentiell zunimmt. Das oft genannte Mooresche Gesetz ist entgegen der Annahme vieler Menschen lediglich ein Teil dieser universellen, dauerhaften und unaufhaltbaren Entwicklung und besagt ausschließlich, dass sich die Anzahl der Transistoren in einem dichten integrierten Schaltkreis etwa alle zwei Jahre verdoppelt. Die in deiner Frage eingefügte Grafik zeigt einige Beispiele dafür.

Kurzweil hat in seinem Buch "Menschheit 2.0: Die Singularität naht" diese Entwicklung in sechs Epochen unterteilt. Wir befinden uns gegenwärtig am Ende der vierten Epoche, der exponentiellen Entwicklung von Hard- und Software, auf welche die Verschmelzung von menschlicher Intelligenz und Technologie mit Eintreten der technologischen Singularität im Jahr 2045 folgt.

Kurz: Alles, was passieren muss, damit die technologische Singularität eintritt, ist, dass ein Gesetz, das seit mehreren Milliarden Jahren Bestand hat, für 25 weitere Jahre Bestand hat.

Ich habe das Buch nicht gelesen, aber mir einige für mich interessante Kapitel der Leseprobe auf Google Books und auf YouTube jeweils Horst Lünings Buchbesprechung und die auf dem Buch basierende Doku "The Singularity Is Near: A True Story About the Future" angesehen.

Soweit ich das beurteilen kann, erklärt Kurzweil das Thema mit vielen Beispielen sehr anschaulich, sodass auch Laien, die sich neu für dieses Thema interessieren, verstehen, was es mit der technologischen Singularität auf sich hat und welche weitreichenden Folgen sich daraus für die Menschheit ergeben.

Mir persönlich sind Kurzweil's Ansichten zu Hardcore - auch wenn ich befürchte, dass diese sehr nahe an der Realität und an der Technikentwicklung sind, wie wir sie derzeit beobachten.

ich glaube nicht, dass es noch bis zum Jahre 2045 dauern wird, bis wir eine KI entwickelt haben, welche mit dem menschlichen Gehirn gleichzusetzen ist und dieses sogar übertreffen wird.

Ich bin aber absolut kein Fan des transhumanistischen Gedankens. Ich strebe danach, mich selbst zu verbessern - aber nicht mit technischen Hilfsmitteln. Ich will keine Chips im Körper haben und keine anderen Schnittstellen ausser meinen natürlichen Sinnen.

Ich habe in diesem Zusammenhang immer wieder die "Borg" aus Stark Trek vor Augen: Cyborgs, welche halb Mensch, halb Maschine, nur noch als Individuum handeln - auch wenn man in einem der Filme irgendwann das Konzept der "Borg-Königin" eingebracht und damit alle anderen Borgs zu reinen Sklaven verwandelt hat. Aber das ist jetzt ein anderes Thema.

Ich sehe die Entwiclung leider eher mehr in Richtung "Terminator" laufen: Eine verteilte KI, welche erkennt, wie schädlich die Gattung Mensch für diesen Planeten ist.

Wenn man sich erhlich eingesteht, dann wird man nämlich erkennen, dass wir uns die Erde zwar "untertan2 gemacht haben - dass dies aber keinesfalls zum Wohle der Erde gewesen ist! Der Mensch ist ein zerstörerisches Raubtier - daran wird auch der Transhumanismus nichts ändern.

Back to topic:

Aufgrund des Moor'schen Gesetzes kann man möglicherweise einen Zeitpunkt berechnen, wie Kurzweil es getan hat. Nur sollte man sich auch unbedingt fragen: Und dann? Was passiert ab dem Zeitpunkt der Singularität?

Es ist nämlich durchaus möglich, dass dies auf dieser Erde bereits ein- oder mehrmals geschehen ist: Der völlige Zusammenbruch einer technischen Zivilisation am höchsten Punkt ihrer Entwicklung.

Das kann uns übrigens auch - und zwar jederzeit - geschehen. Denn was würde geschehen, wenn es ab morgen keinen Strom mehr gibt???

Gerade deinem ersten Teil stimme ich zu, auch wenn ich nicht der Fragesteller bin. Aber nein, wäre sowas schon mal passiert, gäbe es logischerweise irgendwelche Anzeichen. Es müsste Überreste dieser Zivilisation geben, die Ressourcen müssten bereits ausgebeutet sein usw.

Vielleicht gibt es diese Überreste doch - und wir sehen sie nicht? Oder man "zerklärt" diese Überreste zu vollkommen anderen Dingen.

Denke bitte an die Legende von Atlantis und vor allem an die große Sintflut. Diese Legenden gibt es in jeder uns bekannten Kultur und überlieferten Menschengeschichte. Diese Legenden kommen ganz siche rnicht von ungefähr, sondern müssen irgendwo einen wahren Kern besitzen.

Zivilsationen können sich übrigens auch ohne die Ausbeutung der Erde und ihrer Ressourcen entwickeln - und dann an anderen Gründen untergehen.

Ein interessanter Gedanke, sich die Geschichte um Atlantis so zu erklären, ABER: Zwangsweise muss es dafür keinen wahren Kern geben, die gängige Erklärung, Platon habe sich dies als Gleichnis ausgedacht, halte ich für plausibler. Und nein, für Maschinen bedarf es Ressourcen - du sprachst ja selbst von einer tech. Singularität. Und selbst wenn damalige Wesen sofort einen Supercomputer schaffen konnten (ohne die Geschichte der Entwicklung und Ausbeutung), so würde diese auf jeden Fall nach Energie, sprich Ressourcen, gedürstet haben.

Das Konzept einer technologischen Singulartät ist solange NICHT plausibel, solange man KI mit etwas verwechselt, das Bewusstsein entwickeln kann.

Bewusstsein ist nichts, das man konstruieren könnte (wie man KI konstruieren kann).

Ob man eine KI konstruieren kann, die ein Bewusstsein entwickelt, lässt sich bisher noch nicht beantworten. Aber auch daran wird ja bereits intensiv gearbeitet - siehe zum Beispiel das Ehepaar Blum.

Ich kenne das Ehepaar Blum nicht (Wo kann man darüber was lesen?).

Tatsache aber ist, dass heute niemand zu sagen weiß, wie Bewusstsein zustande kommt (oder gar seine Fähigkeiten). Das Wort "künstliche Intelligenz" verschleiert diese Tatsache. Es ist nur marketingtechnisch hilfreich (da es Qualität vortäuscht, die wertvoll wäre, aber gar nicht gegeben ist — was aber nur Fachleuten klar ist).

Da hast du mit Sicherheit nicht ganz unrecht. Hier ein interessanter Artikel über die Arbeit der Blums:

https://www.derstandard.at/story/2000080439080/ein-informatikerpaar-will-gefuehle-in-robotern-wecken

Das ist ein schön geschriebener Artikel. Aber glaube mir: Auch den beiden wird es nicht gelingen, Roboter zu bauen, die fühlen oder z.B. Sorge und Glück empfinden können. Von freiem Willen ganz zu schweigen.

Die Kernfrage ist ja, ob Gefühle anstatt auf biologischer Basis auch auf Basis von Kunststoff und Metall möglich sind. Wären sie das, müsste auch ein Roboter mit Gefühlen prinzipiell machbar sein.

Bisher gibt es überhaupt keine Anzeichen dafür, dass Nicht-biologisches in der Lage sein könnte, Gefühle zu entwickeln (letztlich also Bewusstsein).

Es gibt aber auch keinen Grund zur Annahme, dass es unmöglich ist. Die Zukunft wird es zeigen.

Da ich in der Zwischenzeit bei diesem Thema einiges dazugelernt habe, möchte ich die Diskussion noch einmal aufwirbeln.

Bewusstsein ist nichts, das man konstruieren könnte (wie man KI konstruieren kann).

Dem Thema hat Ray Kurzweil ein ganzes Buch gewidmet - "How to Create a Mind" (die deutsche Übersetzung hat den Titel "Das Geheimnis des menschlichen Denkens"), das sehr viel diskutiert wurde und wird. Er schlägt darin seine "Pattern Recognition Theory of Mind" vor, welche besagt, dass das Gehirn Millionen an Mustererkennern und Module benutzt, die diese Mustererkenner kontrollieren, organisieren und unter den entsprechenden Voraussetzungen vergrößern:

https://www.amazon.de/How-Create-Mind-Thought-Revealed/dp/0670025291

Bezüglich der philosophischen Probleme kann ich dir dieses Video von Horst Lüning sehr empfehlen:

https://www.youtube.com/watch?app=desktop&v=5Ma33-ibjHs

Hier bespricht er das Buch generell:

https://www.youtube.com/watch?v=KhZcjOeqXNo&t=750s

Er denkt also, dass wir, wenn wir diese komplexen Strukturen erstmal detailgetreu nachbauen können, auch im Silizium ein Bewusstsein erschaffen werden können.

Ich habe das Buch noch nicht gelesen, es klingt aber fürs Erste einmal hochinteressant, daher würde ich es dir dennoch empfehlen.

Ich denke, nein.

Über künstliche Intelligenz hat man schon vor über 50 Jahren gefaselt und wir sind noch meilenweit davon entfernt. Und jetzt soll es in 20 Jahren plötzlich soweit sein? Und dann noch uns überlegen?

Der prognostizierte Zeitpunkt der technologischen Singularität wurde schon öfter verschoben. Allerdings ist davon auszugehen, dass sie sehr plötzlich eintritt - sogar für die an der Entwicklung Beteiligten. Begründet wird die Vorhersage mit dem "law of accelerating returns".

Nein nicht im Ansatz so früh. Ich glaube das die meisten Menschen Intelligenz völlig falsch definieren und nicht ganz den Unterschied zwischen unserm Gehirn und einer künstlichen Intelligenz sehen, genauso bin ich mir sicher wir im Laufe der nächsten 100 Jahre sehr viele sehr interessante Dinge über unser Gehirn erfahren werden.

Aber das die künstliche Intelligenz unsere oberflächliche kognitive Intelligenz überschreiten wird ist klar, nur frage ich mich wie genau du meinst was es heißt das KI schlauer wird als wir selbst und "Singularität" eintritt.

Prinzipiell geht es darum, dass der technologische Fortschritt ab diesem Zeitpunkt anstatt durch den Menschen hauptsächlich durch KI beschleunigt wird. Das Ergebnis wäre eine "Explosion" aller technologischen Möglichkeiten und unserer Intelligenz sowie unseres Wissens, deren Folgen nicht mehr absehbar sind. Ich hoffe, das ist einigermaßen verständlich ;-)

Achso, danke für die Info. Ja das kann natürlich deutlich wahrscheinlicher sein. Zu wie viel % würdest du den einschätzen, dass das Ganze wirklich in den nächsten 30 jahren passiert?

Schwierig. Würde mal spontan 40% sagen. Wenn du mich fragst, ob es grundsätzlich eintritt, wäre ich aber bei deutlich über 50%.

Das von dir genannte Buch („Menschheit 2.0“) werde ich mir vermutlich als erstes kaufen. Ist es deiner Meinung nach gut als Einstieg?