AI kann jetzt auch Videos generieren mit unglaublich guter Qualität. Macht das Angst oder freut ihr euch auf die Zukunft?

https://www.youtube.com/watch?v=anmuklFtu8U

und so sah es erst letztes Jahr aus.. Das Tempo in dem sich die AI entwickelt ist unglaublich..

6 Antworten

Hallo NBGcool!

Wie immer und bei allen Dingen gehe ich diverse Dinge neutral an. Alles hat doch immer Positives und Negatives. Warum immer gleich Panik schieben und dramatisieren?

Dass natürlich KI/AI missbraucht wird -gab es in der Vergangenheit auch schon- und es nach wie vor böse Menschen gibt, ist nicht neu und somit ebenfalls klar.

Und, es liegt doch weder an der Technik noch an diversen Menschen, wenn Dritte alles naiv glauben und den Medien, Inhalten usw. Glauben schenken. Insofern ist das ein Problem der Menschen. Wer halbwegs intelligent, skeptisch und neutral ist, wird sich auch nach wie vor nicht von Bild, Ton und Video beeinflussen oder manipulieren lassen.

Ich freue mich darauf und nutze selbst schon KI/AI. Neben Chat GPT nutze ich auch andere KI/AI. In Photoshop, bei anderen Programmen in Adobe, in Office, Online, Video, Content, 3D, Programmierung usw. Noch ist es nicht perfekt, aber schon ziemlich gut in manchen Sprachen und bei manchen Modellen und Anwendungsbereichen. Video & Bild sind schon cool. Allerdings muss es für alle "kostenlos" bzw. "bezahlbar" sein. Natürlich auch uneingeschränkt ohne Bevormundung. Wenn mich die KI/AI bevormundet, dann nutze ich andere KI/AI. So einfach ist das. Ansonsten benötigen ChatGPT und andere KI schon noch Zeit, da oft nur Murks/Mist herauskommt.

Mal abwarten. Ich liebe Technik. Fusionsreaktoren, TeslaBot, Tesla und autonomes Fahren, KI/AI usw. Richtig geil. Willkommen Zukunft.

Das Tempo ist nicht unglaublich. Man muss sich immer vor Augen halten, dass es bereits Tonnen an Material gibt, aus dem die KI lernen kann. Umfelder, für die es dieses Material nicht gibt (etwa beim autonomen Fahren insbesondere in der Stadt) geht es weiterhin nur mit sehr kleinen Schritten vorwärts.

Was ich an Problem sehe ist die Frage, wie man zukünftig Fakes von echtem Material unterscheiden kann. Nehmen wir mal die Politik raus und nehmen die Strafverfolgung als Beispiel. Was wird passieren, wenn der erste Mörder auf die Idee kommt, sich damit zu verteidigen, dass ein Video ein Deep-Fake wäre? Was wird passieren, wenn jemand so etwas erzeugt, um eine Anschuldigung vorzubringen?

Vielleicht ist das eine größere Gefahr für die Demokratie, als man es ich heute vorstellen kann.

Damit bekommen Fakenews-Verbreiter und Trolle noch bessere Werkzeuge an die Hand, um das Vertrauen in den Staat und seine Institutionen zu untergraben.

Das wird so viel Pornos machen.

Für die Filmindustrie ist es vielleicht eine Chance dass jeder jetzt seine eigenen Filme KI Generieren kann ohne Milliarden für Jonny Depp aus zu geben.

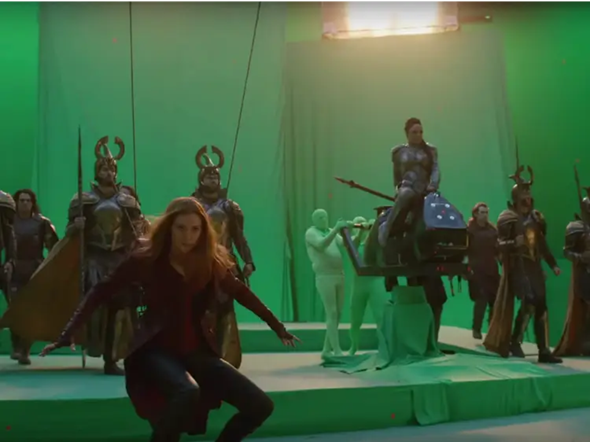

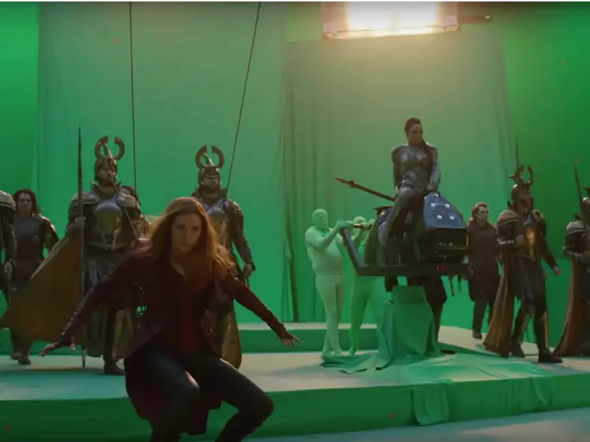

Marvel geht dann von dem hier

Zu dem

Zum anderen ist das natürlich eine Gefahr wegen Fakes die man nicht mehr unterscheiden kann.

Wer wird zukünftig noch in der Lage sein, echte Bilder bzw Videos von generierten zu unterscheiden? Früher oder später ist der Gesetzgeber gefordert, dass KI Bilder / Videos eindeutig als solche gekennzeichnet werden müssen. Was noch lange nicht heißt, dass es auch gemacht wird. Hier wären die Software Entwickler gefordert, dass eindeutige Hinweise eingebaut werden (müssen).

Schon von Anfang an wurden Fotos retuschiert, um ihren Inhalt zu verändern oder zu verfälschen. Immerhin waren das Fachleute. Heute kann (fast) jeder KI generierte Bilder erstellen lassen. Ich will mir auch nicht vorstellen, welche kriminellen Möglichkeiten damit gegeben sind.

Viel schlimmer, welche Bildinformationen werden in Zukunft noch glaubhaft sein?